Un nouveau modèle qui permet aux robots de ré-identifier et de suivre les utilisateurs humains

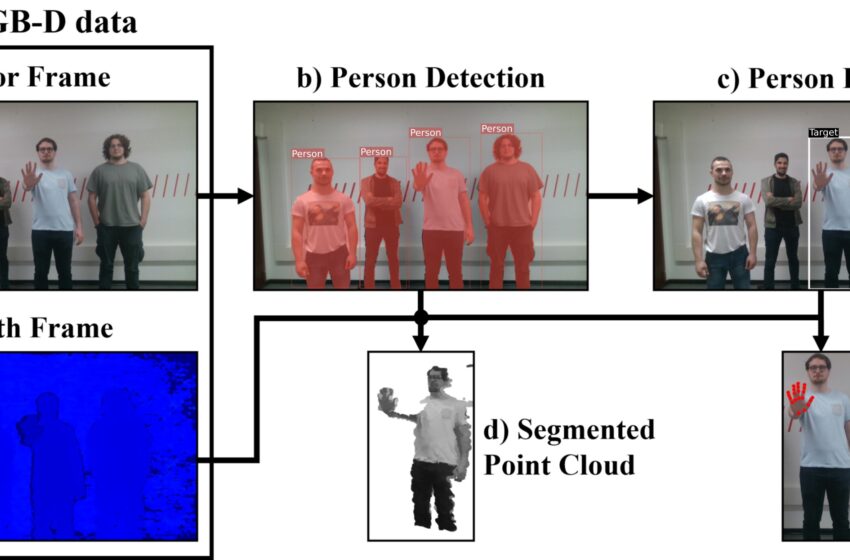

Pipeline de perception : (a) acquisition d’images RVB et profondeur ; (b) détection de personne via Yolact++ (voir Sect. III-A) ; (c) la réidentification de la personne à l'aide d'un réseau neuronal profond et de la distance entre les caractéristiques humaines ; (d) localisation de la personne à l'aide du nuage de points et du masque de personne réidentifiée ; (e) détection de gestes pour envoyer des commandes au robot. Crédit : Rollo et al.

Ces dernières années, les roboticiens et les informaticiens ont introduit divers nouveaux outils informatiques susceptibles d’améliorer les interactions entre les robots et les humains dans des contextes réels. L’objectif primordial de ces outils est de rendre les robots plus réactifs et plus adaptés aux utilisateurs qu’ils assistent, ce qui pourrait à son tour faciliter leur adoption généralisée.

Des chercheurs de Leonardo Labs et de l'Institut italien de technologie (IIT) en Italie ont récemment introduit un nouveau cadre informatique qui permet aux robots de reconnaître des utilisateurs spécifiques et de les suivre dans un environnement donné. Ce cadre, présenté dans un article publié dans le cadre du Conférence internationale IEEE 2023 sur la robotique avancée et ses impacts sociaux (ARSO)permet aux robots de réidentifier les utilisateurs dans leur environnement, tout en effectuant des actions spécifiques en réponse aux gestes de la main effectués par les utilisateurs.

“Nous avions pour objectif de créer une démonstration révolutionnaire pour attirer les parties prenantes dans nos laboratoires”, a déclaré Federico Rollo, l'un des chercheurs qui ont réalisé l'étude, à Tech Xplore. « Le robot de suivi de personne est une application répandue dans de nombreux robots mobiles commerciaux, en particulier dans les environnements industriels ou pour aider les individus. Généralement, ces algorithmes utilisent des émetteurs Bluetooth ou Wi-Fi externes, qui peuvent interférer avec d'autres capteurs et l'utilisateur est obligé de le faire. porter.”

L'objectif principal des travaux récents de Rollo et de ses collègues était de créer un modèle de ré-identification capable de reconnaître des cibles spécifiques dans les images enregistrées par une caméra RVB. Les caméras RVB font partie des capteurs les plus utilisés dans le domaine de la robotique, elles sont donc très faciles à trouver et à intégrer aux systèmes robotiques existants.

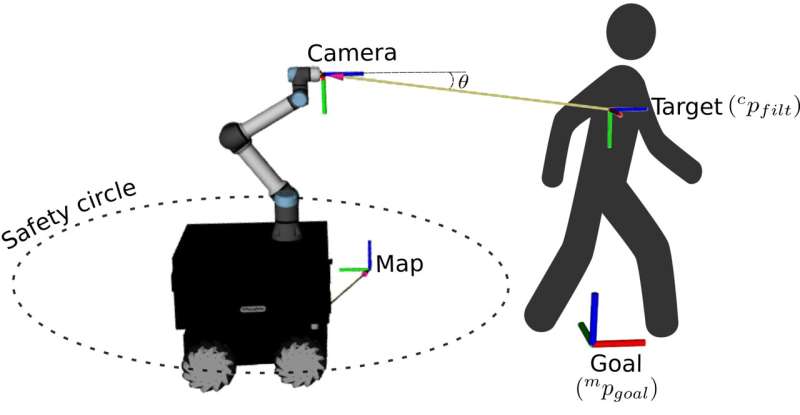

Aperçu des frames de transformation pertinents et représentation du cercle de sécurité utilisé lors de l'application FollowMe. Crédit : Rollo et al.

“Le module de ré-identification que nous avons développé comprend deux étapes consécutives : une étape d'étalonnage et une étape de ré-identification”, a expliqué Rollo.

“Pendant l'étape d'étalonnage, il est demandé à la personne cible de se déplacer de manière aléatoire devant le robot. Dans cette phase, le robot utilise un réseau neuronal pour détecter la personne et connaître son apparence sous la forme d'intégrations de réseau (pensez à un vecteur abstrait). représentant les caractéristiques de la personne). Ces intégrations sont ensuite utilisées pour créer un modèle statistique qui représente la cible.

Dans la deuxième étape de son traitement, le module créé par les chercheurs réidentifie les cibles alors qu'elles se déplacent naturellement dans leur environnement. Le cadre y parvient en analysant les images acquises par une ou plusieurs caméras RVB, en détectant les personnes dans ces images, en calculant leurs caractéristiques et en comparant ces caractéristiques avec celles décrites dans un modèle de l'utilisateur cible créé lors de la phase d'étalonnage.

“Si certaines caractéristiques correspondent statistiquement au modèle, la personne possédant ces caractéristiques est sélectionnée comme cible”, a déclaré Rollo. “Ces informations sont ensuite envoyées à un module de localisation, qui calcule la position 3D de l'utilisateur cible et envoie des commandes de vitesse au robot pour qu'il se dirige vers lui. De plus, l'application comprend un module de détection de gestes.”

Le modèle de détection de gestes créé par Rollo et ses collègues détecte les gestes spécifiques de la main d'un utilisateur cible et envoie des commandes au robot alignées sur ces gestes. Par exemple, si un utilisateur place une main ouverte devant le champ de vision du robot, cela déclenche la commande d'arrêt, indiquant au robot de s'arrêter. A l’inverse, si l’utilisateur présente une main fermée, le robot recommencera à fonctionner.

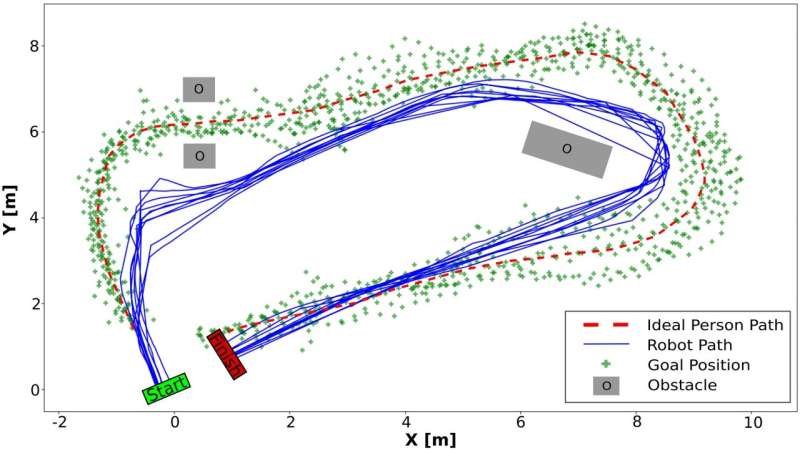

Résultats de l'expérience FollowMe : chaque personne doit suivre un chemin idéal (ligne pointillée rouge) tandis que le robot (ligne bleue) doit le suivre. Les positions des objectifs calculées à partir des données du module de perception sont représentées par des signes plus verts. Le robot est placé dans la position de départ verte et doit suivre la cible jusqu'à ce que la position d'arrivée rouge soit atteinte. Crédit : Rollo et al.

Jusqu’à présent, les chercheurs ont testé leur cadre dans une série d’expériences utilisant le robot Robotnik RB-Kairos+. Il s'agit d'un manipulateur robotique mobile conçu pour être principalement introduit dans les environnements industriels, tels que les entrepôts et les sites de fabrication.

“Le module de réidentification a démontré une robustesse remarquable lors des tests, même dans des zones très fréquentées”, a déclaré Rollo. “Ce comportement robuste ouvre diverses applications pratiques. Par exemple, il pourrait être utilisé pour déplacer des objets très chargés dans un environnement industriel, guider un robot vers différentes stations dans un environnement collaboratif ou industriel, ou aider des personnes âgées à déplacer leurs biens au sein d'un environnement collaboratif ou industriel. maison.”

Le nouveau cadre de réidentification et de détection des gestes développé par cette équipe de chercheurs pourrait bientôt être appliqué et testé plus en détail dans divers scénarios du monde réel qui nécessitent que des robots mobiles suivent des humains et transportent des objets de manière autonome. Avant de pouvoir le déployer à grande échelle, Rollo et ses collègues prévoient toutefois de surmonter certaines limites du modèle identifiées lors de leurs premières expériences.

“Une limitation notable est que le modèle statistique acquis pendant la phase d'étalonnage reste constant pendant la réidentification”, a ajouté Rollo.

“Cela signifie que si la cible change d'apparence, par exemple en portant des vêtements différents, l'algorithme est incapable de s'adapter et nécessite un recalibrage. De plus, il existe un intérêt exprimé pour l'exploration de nouvelles approches pour adapter le réseau neuronal lui-même afin de reconnaître la cible. , en tirant potentiellement parti des méthodes d'apprentissage continu. Cela pourrait améliorer la correspondance statistique entre le modèle cible et les caractéristiques extraites des images RVB, offrant ainsi un système plus adaptatif et flexible.

Plus d'information:

Federico Rollo et al, FollowMe : un cadre de suivi de personne robuste basé sur la réidentification visuelle et les gestes, Conférence internationale IEEE 2023 sur la robotique avancée et ses impacts sociaux (ARSO) (2023). DOI : 10.1109/ARSO56563.2023.10187536. Sur arXiv: DOI: 10.48550/arxiv.2311.12992

arXiv

© 2023 Réseau Science X

Citation: Un nouveau modèle qui permet aux robots de ré-identifier et de suivre les utilisateurs humains (11 décembre 2023) récupéré le 11 décembre 2023 sur

Ce document est soumis au droit d'auteur. En dehors de toute utilisation équitable à des fins d'étude ou de recherche privée, aucune partie ne peut être reproduite sans autorisation écrite. Le contenu est fourni seulement pour information.